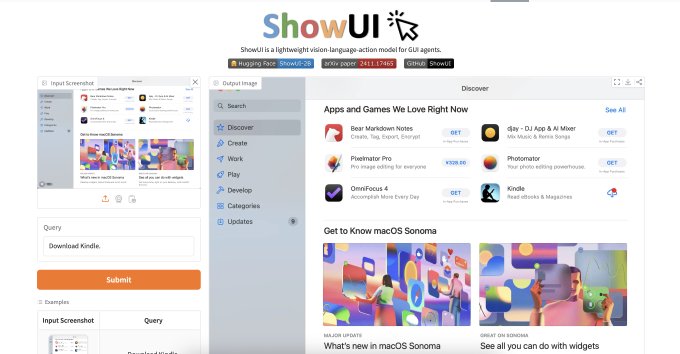

ShowUIは、Qwen2VLアーキテクチャをベースにした視覚-言語-動作多モーダルAIモデルで、ユーザーインターフェース(UI)の要素を認識し、操作を自動化することができます。以下に特徴や機能をまとめます。

主な機能

- 視覚認識と指令理解

- UI のスクリーンショットを「見て」理解。

- クリック、入力、選択、スクロールなどの操作を自動実行。

- 自然言語で操作可能

- プログラミングの知識不要。自然言語だけで指示を出せます。

- コード不要の GUI 自動化

- ソースコードへの依存なし。スクリーンショットを基にUIを解析して操作します。

- 冗長情報を削減

- 冗長な視覚トークンを自動的に33%削減。

- 性能が1.4倍向上、零ショットのUI要素特定精度は**75.1%**に達します。

- 多様なデバイスをサポート

- ウェブインターフェースおよびスマートフォンのUIで利用可能。

応用例

- PC やスマートフォンの自動操作

- UI テストや効率化ツールとして利用

- GUI を使ったタスクの自動化

リソース

- GitHub: ShowUI プロジェクト

このツールを使えば、誰でも簡単にGUI操作を自動化でき、日常業務や開発の効率を大幅に向上させることが可能です。